8 Minute

Notificare neașteptată: un SMS la 2 dimineața

Imaginează-ți un mesaj care aterizează pe telefonul unui părinte la ora 2:00: "Adolescentul dvs. a căutat conținut despre auto-vătămare." Scurt. Șocant. Imposibil de ignorat.

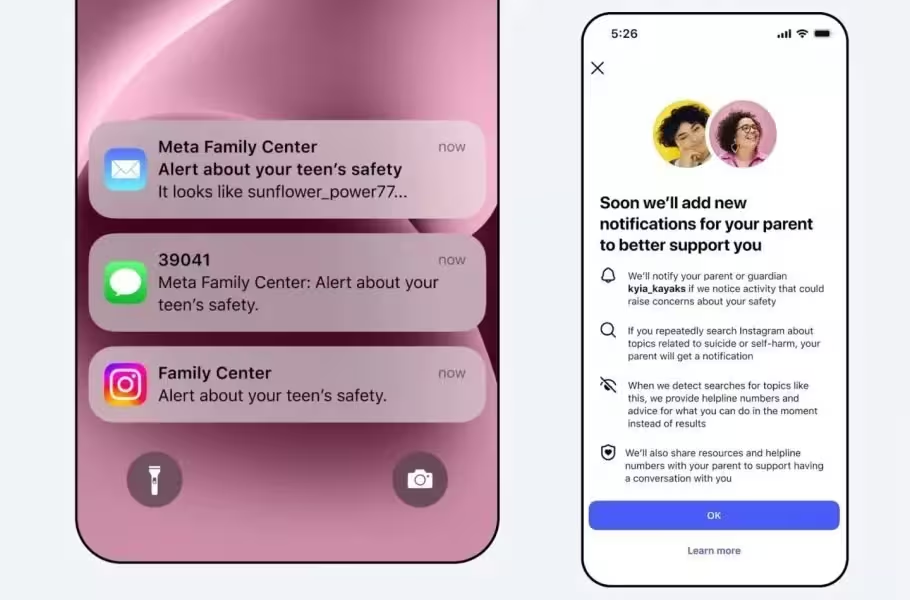

Ce anunță Meta

Meta spune că acesta este exact scopul. Compania va începe să notifice părinții atunci când conturile adolescenților caută în mod repetat termeni asociați sinuciderii sau auto-vătămării într-o perioadă scurtă de timp. Funcția este programată să se lanseze săptămâna viitoare pentru profilurile de adolescenți din Statele Unite, Regatul Unit, Australia și Canada, urmând o extindere globală mai largă planificată până la sfârșitul anului.

Cortina de avertismente: condiții și limitări

Sunt însă anumite avertismente. Acest sistem funcționează numai în gospodăriile care au deja activate instrumentele de supraveghere parentală ale Instagram. Această funcție necesită ca acele controale să fie activate înainte ca alertele să poată ajunge la îngrijitori. Instagram blochează deja unele rezultate de căutare dăunătoare și direcționează utilizatorii către resurse de sprijin, dar aceasta este prima dată când platforma va transmite proactiv informații părinților bazate pe comportamentul de căutare al unui tânăr.

Cum vor fi contactați părinții?

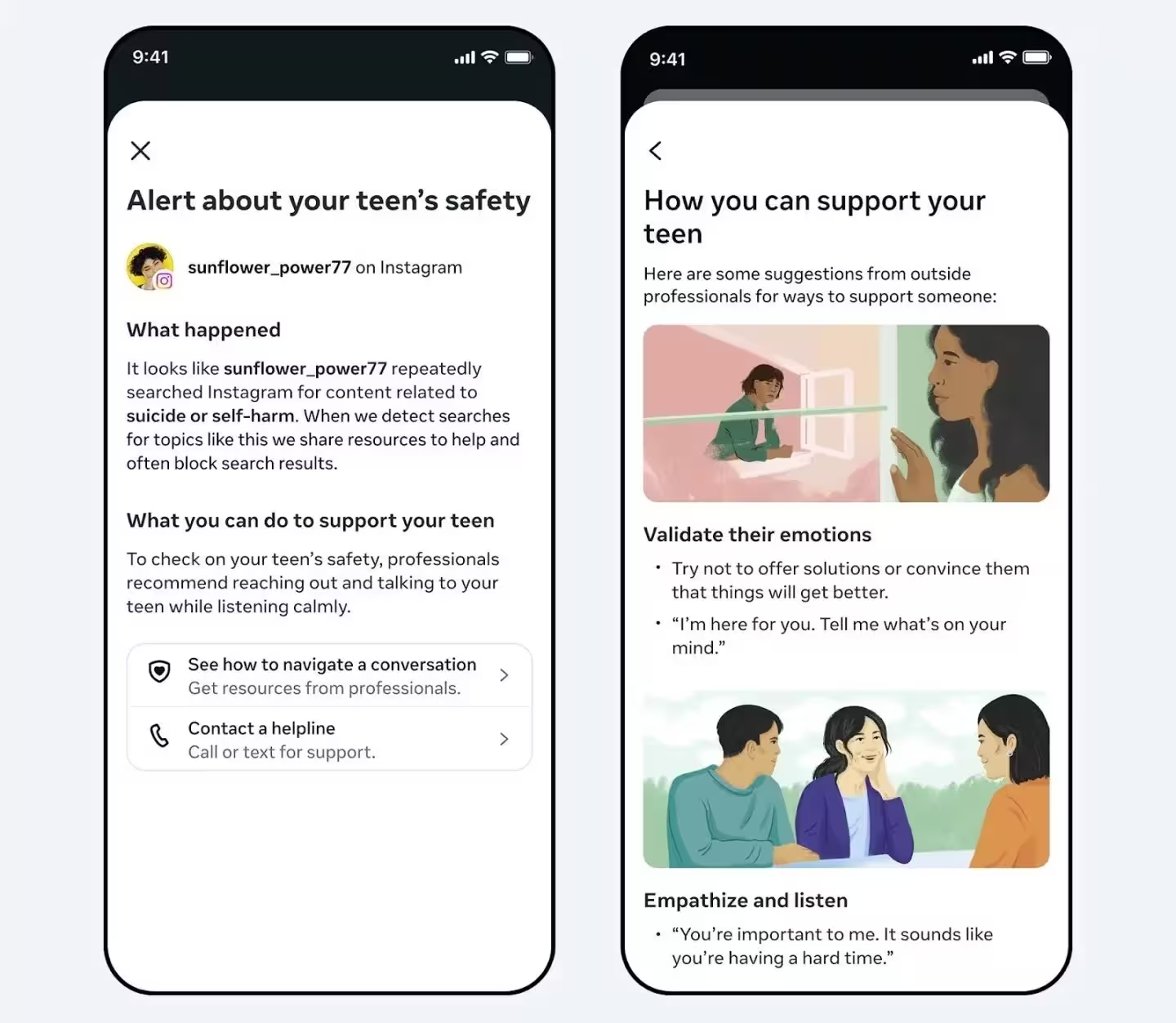

Meta declară că va folosi metoda de contact asociată contului de supraveghere — mesaje text, email, WhatsApp sau notificări în aplicație — în funcție de informațiile disponibile. Fiecare alertă va fi însoțită de îndrumări și resurse educaționale menite să ajute familiile să inițieze conversații dificile și să găsească ajutor profesional acolo unde este necesar. Meta descrie sistemul ca intenționat precaut; acesta poate semnala tipare suspecte chiar și atunci când pericolul nu este cert, prioritizând siguranța în detrimentul tăcerii.

Reacții critice și îngrijorări

Nu toată lumea este liniștită. Andy Burrows, CEO al Molly Rose Foundation, avertizează că alertele bruște pot înspăimânta îngrijitorii nepregătiți pentru o criză și că mișcarea riscă să transfere responsabilitatea de pe platformă pe umerii familiilor. Fundația — înființată după sinuciderea din 2017 a lui Molly Russell, în vârstă de 14 ani — afirmă că Instagram încă recomandă conținut legat de depresie și auto-vătămare tinerilor și consideră că remedierea amplificării algoritmice ar fi o soluție mai semnificativă decât externalizarea problemei către familii.

Ce se schimbă concret pentru utilizatori?

Pentru adolescenți, căutările care anterior generau un ecran redirecționat către resurse de sprijin vor alimenta acum și un traseu de notificare către părinți atunci când tiparele sugerează intenție repetată. Pentru părinți, un mesaj ar putea fi primul semn al unui lucru ascuns; pentru avocați și specialiști în sănătate mintală, este o reamintire că detectarea nu înseamnă prevenire și că platformele trebuie să-și asume responsabilitatea pentru efectele downstream ale recomandărilor lor către utilizatorii vulnerabili.

Analiză: stop-gap sau schimbare structurală?

Aceasta este, până la urmă, o soluție temporară. Totodată, este și un reflector. Va salva o alertă un copil aflat în criză sau va declanșa o dezbatere mai amplă despre cine răspunde pentru răul online? Discuția a început deja — iar răspunsurile vor modela modul în care platformele, familiile și autoritățile de reglementare gestionează sănătatea mintală a tinerilor în mediul online.

Context tehnic: cum detectează Instagram semnalele de risc

Detecția se bazează, în esență, pe analiza termenilor căutați, frecvența acestor căutări și intervalele lor. Algoritmii pot clasifica interogările în categorii precum: gânduri de sinucidere, metode de auto-vătămare, sau conținut auto-glorificator. Când un model temporal indică preocupare repetată — de exemplu, mai multe căutări într-un interval scurt — sistemul generează un semnal intern. Acest semnal este apoi comparat cu praguri prestabilite pentru a decide dacă trebuie trimisă o alertă părinților care au activat supravegherea parentală.

Limitările algoritmice

Modelele linguistice și de clasificare nu sunt infailibile. Ambiguitatea limbajului, argoul juvenil sau căutările care au scopuri de cercetare pot genera rezultate false pozitive. În plus, diferențele de limbă și dialect pot reduce acuratețea în zonele neanglofone. Meta afirmă că prioritatea este siguranța, ceea ce înseamnă că sistemul poate fi setat să favorizeze o sensibilitate mai mare chiar cu costul unei rate mai mari de alarme false.

Confidențialitate și securitate a datelor

Un aspect critic este modul în care datele sunt utilizate și protejate. Notificările se bazează pe metadate asociate contului de supraveghere, iar Meta afirmă că nu partajează explicit conținutul căutărilor cu persoane terțe. Cu toate acestea, centralizarea acestor semnale și trimiterea lor către conturi terțe (părinți) ridică întrebări despre conservarea datelor, criptare și posibilitatea abuzului de informații sensibile.

Implicații pentru sănătatea publică și profesioniști

Profesioniștii în sănătate mintală privesc această măsură ca pe o posibilă cale de a identifica adolescenți în risc înainte ca situația să se agraveze. În practică, o alertă ar trebui să fie urmată de pași concreți: contactarea adolescentului cu empatie, evaluarea riscului imediat, căutarea suportului profesional și, dacă este necesar, intervenția de urgență.

- Pas 1: Abordare calmă și deschisă cu adolescentul.

- Pas 2: Evaluarea riscului — gânduri, planuri, mijloace.

- Pas 3: Contactarea unui specialist în sănătate mintală sau serviciilor de urgență dacă riscul este ridicat.

- Pas 4: Monitorizare continuă și acces la resurse educaționale.

Critici și alternative propuse

Criticii susțin că simpla notificare a părinților nu tratează cauza principală: amplificarea algoritmică a conținutului dăunător. Alternativele propuse includ:

- Reducerea promovării conținutului care normalizează auto-vătămarea.

- Revizuirea și transparența algoritmică în recomandări.

- Îmbunătățirea resurselor de sprijin integrate direct în aplicație pentru tineri.

Rolul reglementatorilor

Autoritățile pot impune standarde pentru responsabilitatea platformelor în gestionarea conținutului periculos. Reglementările pot include cerințe de audit pentru algoritmi, protocoale clare de intervenție în caz de semnale de risc și garanții pentru protecția datelor utilizatorilor minori.

Ce pot face părinții acum?

Părinții interesați de această funcție trebuie să activeze instrumentele de supraveghere parentală ale Instagram pentru a primi alerte. Totuși, este esențial ca ei să se pregătească pentru un dialog constructiv:

- Educați-vă despre semnele de suferință emoțională și sănătate mintală.

- Stabiliți un mediu sigur pentru discuții fără judecată.

- Cunoașteți resursele locale de suport și serviciile de urgență.

- Colaborați cu profesioniști — psihologi, consilieri școlari, medici.

Concluzii: între prevenție și responsabilitate

Funcția de alertă anunțată de Meta pentru Instagram este una dintre multele măsuri ce încearcă să facă internetul mai sigur pentru adolescenți. În esență este o măsură reactivă, menită să conecteze semnalele digitale cu acțiunea umană. Însă eficiența ei depinde de modul în care platformele reduc expunerea la conținut dăunător, de pregătirea părinților și de accesul la servicii profesionale de sănătate mintală.

Dezbaterile care vor urma vor modela nu doar o funcție tehnică, ci politici și practici care influențează sănătatea publică, protecția copilului și responsabilitatea companiilor tehnice. Rămâne esențial ca toate părțile — platformele, familiile, profesioniștii și regulatorii — să coopereze pentru a transforma semnalele într-o intervenție eficientă și etică.

Detecția este un prim pas; prevenirea reală înseamnă intervenție adecvată, reducerea amplificării algoritmice și sprijin continuu pentru tinerii vulnerabili.

Resurse utile

Pentru părinți și îngrijitori: căutați linii telefonice de criză, servicii locale de sănătate mintală și organizații non-profit specializate în prevenirea suicidului și sprijin pentru adolescenți. Exemple includ servicii naționale de urgență, organizații de consiliere și ghiduri educaționale despre sănătatea mintală a tinerilor.

Notă: articolul se bazează pe declarațiile publice ale Meta și pe reacțiile organizațiilor de advocacy; datele tehnice reflectă explicațiile furnizate de companie privind funcționarea sistemelor de detecție.

Sursa: smarti

Lasă un Comentariu