8 Minute

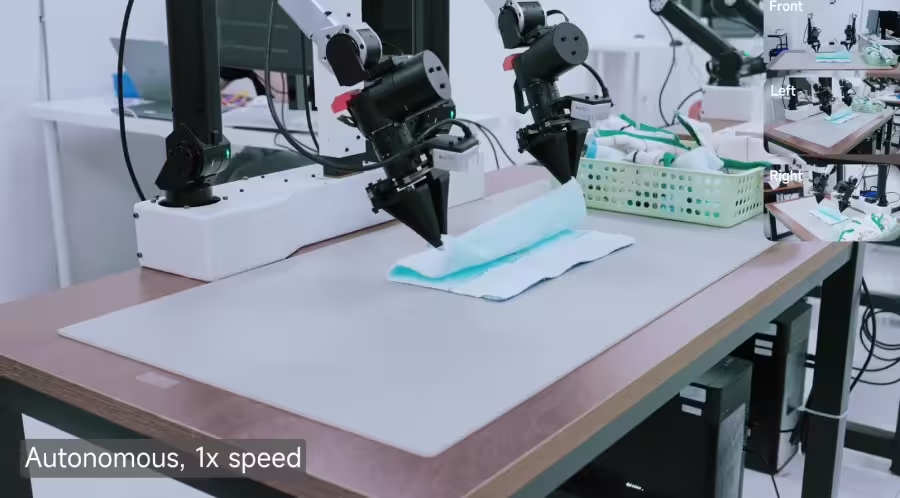

Un prosop pliat ca și cum ar fi fost mânuit de o persoană atentă. Blocuri demontate cu mâini calme. Fețe mici, poate, dar foarte elocvente. Modelul nou Robotics-0 de la Xiaomi nu este un gadget strălucitor de consum; este un demers de a învăța mașinile să vadă, să înțeleagă și să se miște cu o finețe pe care, multă vreme, am atribuit-o intuiției umane. Această demonstrație de manipulare indică progrese în robotică, manipulare dexteră și viziune-comportament (vision-action) care ar putea influența roboții casnici și industriali. Observațiile din laborator — plierea ordonată a unui prosop moale sau demontarea atentă a unor blocuri rigide — relevă capacități concrete de coordonare ochi-mână, planificare pe termen lung și tratament multimodal al informației (imagine + limbaj), toate componente esențiale pentru roboți autonomi de înaltă acuratețe.

În esență, Robotics-0 încearcă să închidă bucla care definește orice robot capabil: percepție, decizie, execuție. Compania denumește acest ansamblu „inteligență fizică” — o sintagmă concisă care ascunde un pachet de probleme dificile din robotică, învățare automată și procesare multimodală. Cum păstrezi un sistem ascuțit la raționamente lingvistice și vizuale, oferindu-i în același timp capacitatea de a executa mișcări cu precizie milimetrică? Răspunsul Xiaomi se regăsește într-o arhitectură care separă partea de „gândire” de cea de „mișcare”, permițând optimizări diferite pentru fiecare responsabilitate fără a compromite abilitățile cognitive sau motorii.

Pe de o parte se află un Visual Language Model — gândiți-vă la el ca la interpretul robotului. Acesta procesează fluxuri video la rezoluție înaltă și instrucțiuni umane, inclusiv instrucțiuni vagi de tipul „Te rog, pliază prosopul.” Modelul tratează detectarea obiectelor, relațiile spațiale, întrebările și răspunsurile vizuale (Q&A) și raționamentul de bun-simț necesar pentru a transforma pixeli în sarcini concrete. Pe de altă parte stă Action Expert: un Diffusion Transformer conceput nu pentru a emite o singură comandă motorie, ci pentru a genera un "Action Chunk" — o scurtă secvență coordonată de mișcări. În practică, aceasta înseamnă tranziții mai fluide, corecții mai puțin bruște și o planificare discretă a mișcărilor care reduce tremuratul mecanic și corecțiile reactive intempestive.

Alegerea inginerească din spatele acestei separări este o arhitectură denumită Mixture-of-Transformers. Responsabilitățile sunt repartizate în loc să fie forțate într-un singur model monolitic. Această separare abordează o problemă notorie în domeniu: odată ce antrenezi un model vizual-limbaj să acționeze, el își poate pierde uneori marginea în raționament lingvistic sau vizual deoarece optimizarea pentru acțiune "mănâncă" din capacitățile de inferență. Pentru a evita acest compromis, Xiaomi antrenează în comun (co-train) pe date multimodale și traiectorii de acțiune, astfel încât partea de percepție să-și păstreze robustețea în timp ce partea de execuție învață să coordoneze mișcări fine. Această strategie de învățare multimodală și multi-etapă optimizează atât calitatea înțelegerii limbajului și imaginii, cât și acuratețea traiectoriilor robotice.

Antrenamentul este desfășurat pe etape. Mai întâi are loc o fază de Action Proposal, în care modelul vizual prezice distribuții peste acțiuni plauzibile în timp ce analizează imaginea; acest pas aliniază reprezentările interne ale „văzutului” cu cele ale „acționatului”. Apoi partea vizuală este înghețată (frozen) pentru a păstra capacitatea de raționare dobândită. Diffusion Transformer-ul se antrenează ulterior să denoiseze secvențe de acțiuni — transformând ghicirile zgomotoase în mișcări executabile — fiind ghidat de caracteristici key-value extrase din modelul vizual, în loc să se bazeze exclusiv pe token-uri discrete de limbaj. Această abordare reduce discrepanța dintre predicții și execuție, îmbunătățind robustetea la variații și zgomot în datele senzoriale.

Roboții reali aduc la lumină și fricțiuni practice care nu apar complet în simulări. Latenta este una dintre ele: dacă modelul se oprește să „gândească”, robotul tinde să înghețe sau să se clatine, ceea ce poate duce la pierderea poziției sau la erori de priză. Xiaomi atenuează acest efect prin inferență asincronă: componentele de calcul și cele hardware rulează semi-independente, astfel încât mișcarea rămâne continuă chiar și atunci când modelul mai calculează. Sistemul reincorporează, de asemenea, acțiuni predictate anterior sub forma unui "Clean Action Prefix" — un prefix curat de acțiuni care reduce jitter-ul și menține momentum-ul. O mască de atenție modelată în formă de lambda (Λ) încurajează sistemul să favorizeze indiciile vizuale curente în detrimentul istoricului învechit, ceea ce îmbunătățește sensibilitatea la schimbări bruște din mediul înconjurător. Astfel de soluții pragmatice pentru latență și stabilitate sunt esențiale pentru aplicații reale, de la roboți casnici la roboți colaborativi din industrie.

Benchmark-urile spun doar o parte din poveste. Xiaomi raportează rezultate de top în simulări precum LIBERO, CALVIN și SimplerEnv, depășind aproximativ 30 de sisteme concurente. Aceste suite de testare sunt folosite pe scară largă în comunitatea de robotică pentru a evalua abilități cum ar fi manipularea obiectelor, planificarea pe orizont lung și înțelegerea multimodală. Totuși, numerele din simulări trebuie coroborate cu teste în lumea reală; pe o platformă cu brațe duble, Robotics-0 a gestionat sarcini de lung orizont, cum ar fi plierea prosopului și demontarea blocurilor, demonstrând coordonare ochi-mână stabilă și capacitatea de a trata atât obiecte rigide, cât și flexibile fără erori evidente. Aceste teste practice validează atât designul arhitectural (Mixture-of-Transformers și Action Chunking), cât și strategiile de antrenare (co-training multimodal și denoising pentru difuzie).

Există și un alt punct practic: Xiaomi eliberează Robotics-0 ca proiect open source. Această decizie este importantă pentru viteza cercetării în robotică și inteligență artificială. Când echipele pot inspecta codul, replica experimente, reproduce date și construi pe baza muncii altora, progresul se accelerează — apar fork-uri, replici, extensii hardware și adaptări ale ideilor VLA (vision-language-action) pentru platforme diverse. Lansarea open source favorizează transparența, reproducibilitatea și validarea independentă, aspecte esențiale pentru adoptarea pe scară largă în comunitatea științifică și industrială.

Robotics-0 nu rezolvă însă toate problemele. Manipularea obiectelor moi, generalizarea la medii radical diferite și autonomia completă rămân provocări deschise în cercetare. Manipularea obiectelor deformabile implică modelare fizică complexă și feedback tactil de înaltă fidelitate; adaptarea la medii noi cere reprezentări robuste și strategii de transfer de învățare; iar autonomia totală impune soluții de siguranță, planificare pe termen lung și reziliență la erori. Totuși, modelul indică o direcție pragmatică: mențineți percepția și acțiunea strâns aliniate fără a forța o componentă să înghită cealaltă. În termenii designului de sisteme, aceasta este o amintire că progresul poate veni atât din alegeri arhitecturale inteligente, cât și din mărimea sau complexitatea modelului.

Din punct de vedere tehnic, entități cheie precum "Visual Language Model", "Diffusion Transformer" și "Mixture-of-Transformers" sunt interconectate: primul traduce semnale senzoriale și limbaj în reprezentări semnificative; al doilea planifică și rafinează traiectorii; iar arhitectura mixtă orchestrează colaborarea lor. Alți termeni relevanți pentru indexarea de căutare (SEO) și pentru cititorii tehnici includ: inteligență fizică, manipulare dexteră, învățare multimodală, inferență asincronă, VLA (vision-language-action), benchmark LIBERO/CALVIN, și robotică dual-arm. Folosirea consecventă a acestor entități ajută la clarificarea relațiilor între concepte: percepție multimodală → propunere de acțiune → denoising și execuție; toate integrate printr-o arhitectură modulară.

Dacă vă interesează unde vor mișca roboții pașii următori, urmăriți cum se comportă acest model în afara laboratoarelor Xiaomi și ce componente din cod și algoritmi comunitatea păstrează și rafinează. Așteptați-vă la lucrări de follow-up, replicări experimentale și aplicații adaptate la hardware variat — de la brațe robotice industriale la manipulatoare domestice ușoare. Pe măsură ce dezvoltatorii extind seturile de date, optimizează strategiile de inferență asincronă și perfecționează mecanismele de feedback tactil, vom vedea probabil iterații care reduc și mai mult gap-ul dintre percepție și acțiune.

Următoarea dată când un robot de casă îți va plia prosopul, ai putea zări amprentele Robotics-0 în fiecare pliu neted: o combinație de viziune robustă, raționament lingvistic și planificare a mișcării care transformă pixeli și comenzi vagi în mișcări precise. Această sinergie între tehnici — modele vizual-limbaj, transformere de difuzie pentru acțiune, inferență asincronă și design open source — conturează o cale practică pentru adoptarea roboticii capacitate în aplicații cotidiene și industriale.

Sursa: gizmochina

Lasă un Comentariu