7 Minute

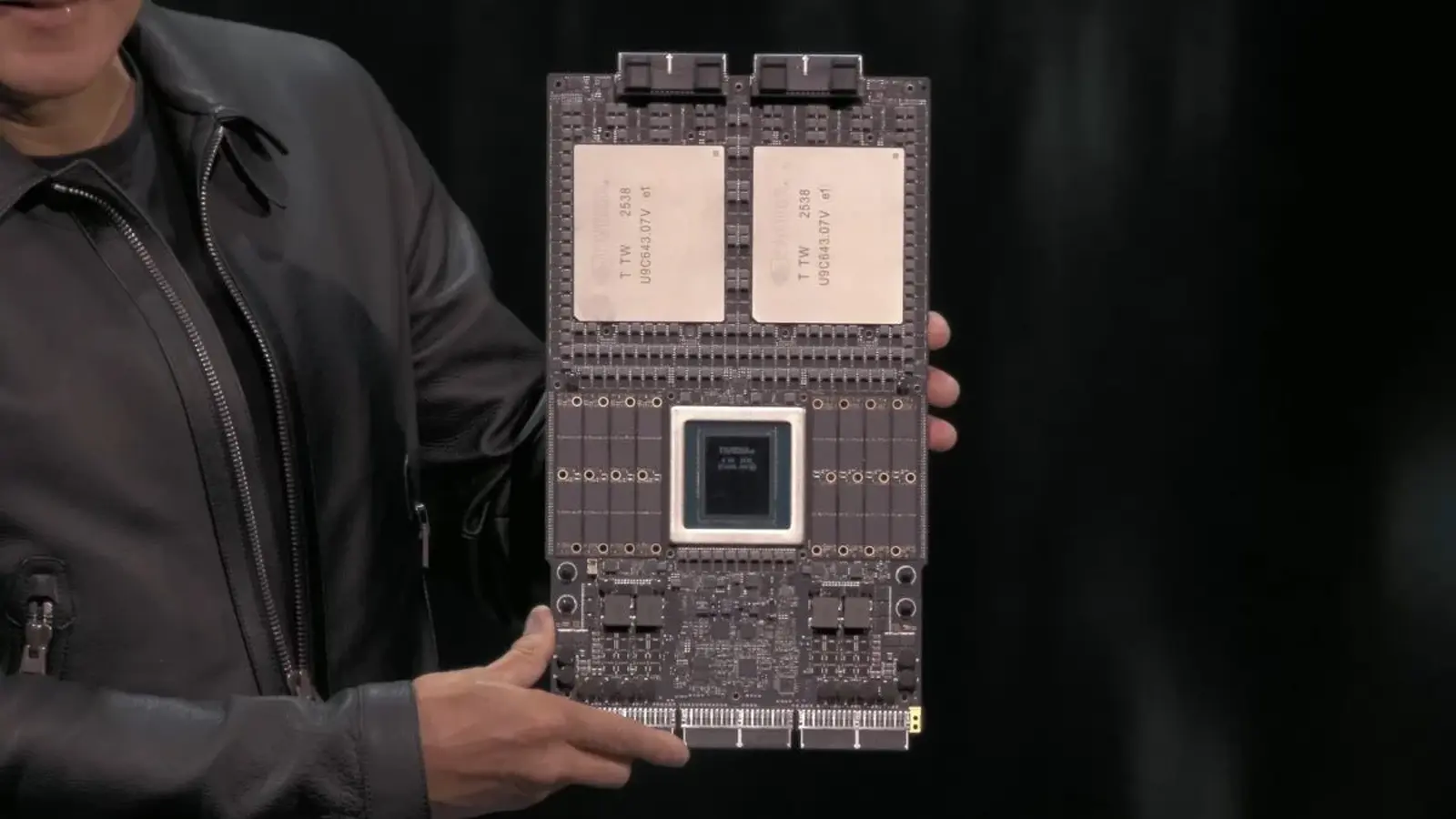

Samsung este, potrivit rapoartelor, foarte aproape de a depăși un obstacol major pentru memoria sa de generație următoare, HBM4, trecând de la etapele de prototip și calificare către producția la scară largă, care ar putea alimenta procesorul AI Rubin de la Nvidia și alți producători de acceleratoare. Această tranziție marchează nu doar o evoluție tehnologică, ci și o potențială schimbare strategică în lanțul global de aprovizionare pentru memoria dedicată aplicațiilor de inteligență artificială. Implementarea HBM4 în volume comerciale ar însemna disponibilitatea pentru centre de date și furnizori de soluții AI care solicită latențe foarte scăzute, throughput foarte ridicat și eficiență energetică optimizată.

De ce contează HBM4 pentru AI

Memoria cu lățime de bandă mare (HBM) constă din stive de die-uri DRAM integrate vertical, conectate prin canale inter-die folosind TSV-uri (through-silicon vias) și, în multe designuri moderne, integrate folosind un interposer. Arhitectura aceasta oferă un throughput mult mai mare și un consum de energie per bit mult redus față de modulele DDR sau LPDDR convenționale, ceea ce o face ideală pentru acceleratoare AI. În sarcinile de antrenare și inferență ale rețelelor neuronale mari, datele — greutăți ale modelului, activări temporare și gradienți — trebuie mutate rapid între memoria disponibilă și fabricile de procesare. HBM minimizează gâturile de comunicație și reduce timpul de așteptare al acceleratoarelor, contribuind direct la performanța generală a sistemului.

HBM4 reprezintă un salt generațional în ceea ce privește atât lățimea de bandă, cât și eficiența energetică, incluzând optimizări la nivel de interconectare, management termic și proiectare a die-urilor DRAM. Producătorii de cipuri caută să asocieze aceste memorii cu procesoare flagship pentru a oferi sisteme capabile să ruleze modele mari la viteze superioare. Pentru furnizorii de acceleratoare AI, adoptarea HBM4 poate reduce timpul de antrenare, poate mări rata de inferență și poate scădea costul energetic pe operație, criterii esențiale în proiectarea centrelor de date moderne.

După ce, în generațiile anterioare, Samsung a rămas în urmă față de rivali în anumite aspecte ale performanței și fiabilității HBM, efortul pentru HBM4 semnalează o revenire competitivă. Surse din industrie indică faptul că aceste noi cipuri ar putea depăși performanțele unor componente echivalente produse de SK Hynix și Micron, ceea ce ar constitui un avantaj strategic semnificativ, având în vedere importanța critică a performanței memoriei pentru fluxurile de lucru AI moderne. Un succes comercial al HBM4 ar putea, de asemenea, forța o reevaluare a poziției pieței de către clienții mari și ar putea conduce la renegocieri ale acordurilor de furnizare cu furnizorii de acceleratoare.

Aprobare, calendar și pași următori

Conform raportului Bloomberg, Samsung a trimis eșantioane HBM4 către Nvidia în septembrie 2025, iar aceste componente au ajuns în etapa finală de calificare. Producția în masă este estimată să înceapă în februarie 2026. Dacă acest calendar se confirmă, Samsung ar putea rapid deveni furnizor nu doar pentru Nvidia, ci și pentru alți clienți importanți de acceleratoare AI, precum AMD și Google. O densitate de producție ridicată combinată cu randamente competitive ar permite Samsung să livreze volume care să susțină lansările comerciale ale unor platforme AI de generație nouă, printre care se numără și procesoare proiectate pentru sarcini de antrenare a modelelor de limbaj mare și pentru infrastructura de inferență în timp real.

Calea Samsung către HBM4 nu a fost lipsită de dificultăți. Generațiile HBM3 și HBM3E au întâmpinat probleme de performanță care au necesitat reproiectări pentru a obține aprobarea Nvidia, un client cheie care are cerințe foarte stricte de calitate, latență și throughput. Unele părți HBM3E au fost folosite doar în selecte acceleratoare Nvidia comercializate în China, ceea ce subliniază cât de riguroase pot fi procesul de calificare și limitările introduse de cerințele regionale sau contractuale. Cu HBM4 raportat ca fiind aprobat pentru etapa finală, pare că Samsung a rezolvat problemele anterioare legate de consistența performanței, controlul termic, integritatea semnalului și randamentele de fabricație.

Impactul unei rampări de succes pentru HBM4 asupra peisajului memoriei poate fi semnificativ. Consolidarea poziției Samsung pe o piață dominată de mult timp de jucători precum SK Hynix și Micron ar putea modifica dinamica ofertelor și prețurilor. Pentru lanțurile de aprovizionare ale chipurilor AI de generație viitoare — inclusiv proiecte cum este Rubin de la Nvidia — disponibilitatea mai multor opțiuni de memorie de înaltă performanță înseamnă o competiție mai sănătoasă, redundanță în aprovizionare și o probabilitate crescută de satisfacere a cererii în creștere pentru capacitate de antrenare și inferență. Mai mult, accesul la HBM4 ar putea stimula inovația în arhitecturile acceleratorilor, de la optimizări de pe partea firmware și drivere până la schimbări la nivel de topologie a memoriei pentru a profita de lățimea de bandă crescută.

Există, totuși, câteva aspecte de urmărit. Producția în masă presupune menținerea unor randamente ridicate, gestionarea costurilor de fabricație și asigurarea unui suport robust pentru integratori. Problemele potențiale includ controlul termic la densități mai mari, asigurarea integrității semnalului la rate de transfer crescute și adaptarea infrastructurii de testare pentru noile specificații. De asemenea, negocierea cu clienți mari ca Nvidia, AMD sau Google implică cerințe de volum, acorduri de livrare și potențiale clauze de exclusivitate care pot influența rapid compoziția pieței. Pe partea pozitivă, o ofertă competitivă de HBM4 din partea Samsung ar putea forța rivalilor să accelereze propriile cicluri de inovație și să îmbunătățească ofertele existente HBM3E/HBM3.

Pentru dezvoltatorii de AI și partenerii hardware, mai multe opțiuni de memorie performantă înseamnă o presiune mai mică asupra lanțurilor de aprovizionare și mai multe oportunități de optimizare a sistemelor în funcție de cost, consum sau performanță. În practică, acest lucru se traduce prin posibilitatea de a construi clustere de antrenare mai mari, de a susține modele cu parametri mai mulți și de a furniza inferențe cu latență mai mică pentru aplicații critice. Din perspectiva centrelor de date, adoptarea HBM4 va necesita evaluări privind compatibilitatea cu plăcile acceleratoare existente, cerințele de răcire și eficiența energetică per rack.

Urmăriți luna februarie 2026: dacă producția în masă începe conform raportărilor, epoca HBM4 va trece din laborator și din stadiul de eșantioane în centrele de date care alimentează AI-ul modern. Această tranziție va rămâne sub monitorizarea atentă a industriei, analiștilor și clienților mari, iar confirmarea livrărilor în volum va fi un indicator important al modului în care se vor remodela parteneriatele în ecosistemul hardware pentru inteligență artificială. În plus, succesul HBM4 ar putea declanșa o nouă rundă de optimizări software și hardware pentru a valorifica pe deplin potențialul unor rate de transfer și eficiență energetică superioare.

Sursa: sammobile

Lasă un Comentariu