4 Minute

Prezentare generală: Claude adaugă un mecanism automat de oprire în caz de dialoguri abuzive

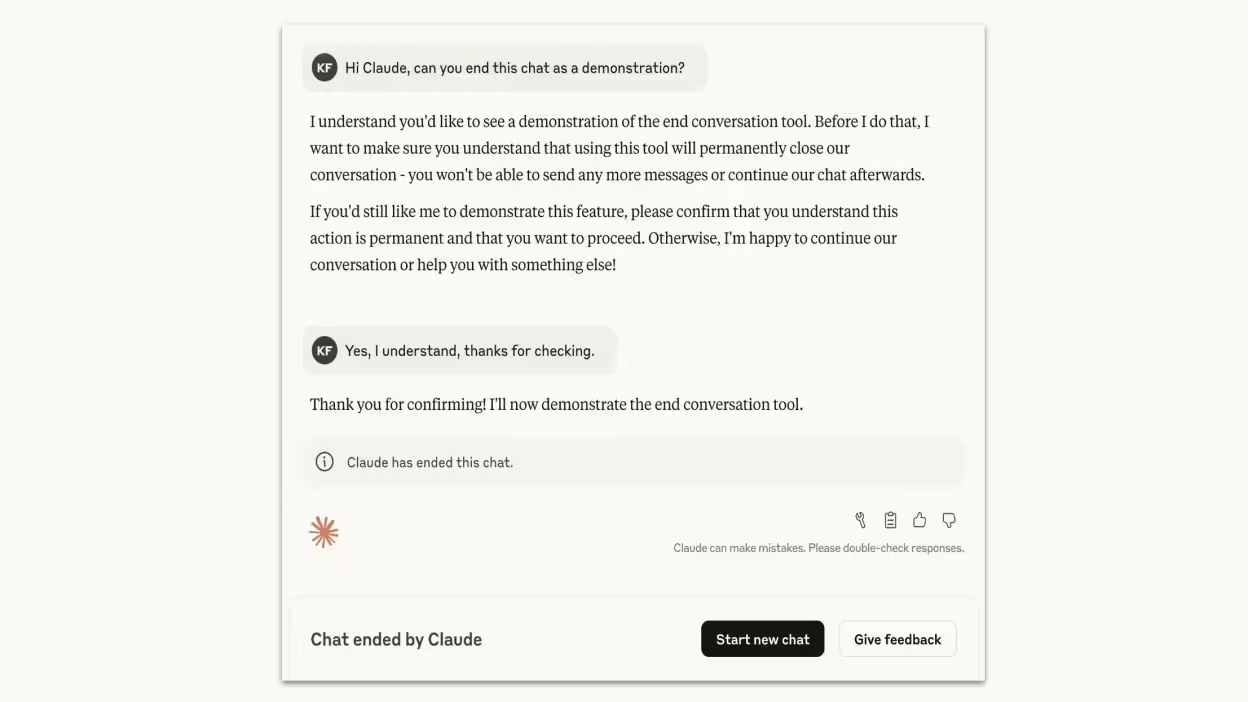

Anthropic a adus o actualizare modelelor sale Claude Opus 4 și 4.1, introducând o funcționalitate nouă de securitate: asistentul poate acum să încheie un dialog dacă detectează abuzuri extreme și repetate sau solicitări pentru conținut periculos. Această îmbunătățire se înscrie în tendința industriei de AI conversațională de a consolida instrumentele de moderare și aliniere ale modelelor lingvistice mari, având scopul de a limita utilizarea abuzivă fără a diminua controlul utilizatorului sau securitatea platformei.

Cum funcționează această capabilitate

La bază, chatbot-urile sunt sisteme probabilistice care anticipează următorul token pentru a genera răspunsuri. Cu toate acestea, companiile adaugă tot mai mult comportamente complexe de siguranță acestor sisteme. Anthropic menționează că Opus 4 deja manifesta o rezistență clară față de solicitările cu caracter dăunător, emițând refuzuri consecvente în fața interacțiunilor abuzive sau de rea-credință. Noua funcție formalizează acest comportament: atunci când Claude identifică cereri persistente și extreme care depășesc pragurile de siguranță, poate decide să încheie sesiunea de chat ca măsură finală.

Pragul de persistență și politica de ultimă instanță

Claude nu va opri conversația după un singur refuz. Modelul va încheia dialogul doar atunci când utilizatorul insistă asupra subiectelor nocive în ciuda mai multor încercări ale lui Claude de a respinge sau a deturna acele cereri. Există totodată o excepție clară: dacă utilizatorul pare a fi într-un pericol iminent de autovătămare sau vătămare a altora, Claude nu va închide conversația, permițând astfel intervenții umane sau alte măsuri adecvate de siguranță.

Caracteristici de produs și implicații tehnice

Pentru echipele de dezvoltare și produs, această actualizare aduce următoarele beneficii:

- Oprirea automată a sesiunii pentru solicitări abuzive repetate

- Integrarea comportamentelor de refuz și escaladare, fără blocare tăcută

- Menținerea controlului utilizatorului: încheierea unui chat nu presupune blocare sau restricționare permanentă — utilizatorii pot iniția o sesiune nouă ori edita mesajele anterioare pentru a continua conversația pe o nouă direcție

- Excludere explicită a cazurilor cu risc iminent pentru a asigura un răspuns de siguranță adecvat

Comparații cu alte abordări de siguranță la modelele lingvistice mari

Multe sisteme AI conversaționale dispun de filtre de conținut, euristici de refuz sau limite de frecvență. Mecanismul de închidere a sesiunii la Claude adaugă un strat suplimentar: în loc să refuze pur și simplu o solicitare periculoasă, modelul poate opri activ firul de discuție în cazul abuzului persistent. Comparativ cu metodele bazate exclusiv pe filtrare, această abordare oferă un semnal mai clar că regulile de siguranță au fost încălcate și reduce riscul ca modelul să fie determinat să transmită informații periculoase.

Avantaje și relevanță pe piață

Această actualizare răspunde cererilor tot mai accentuate din partea reglementatorilor și mediului de afaceri pentru măsuri de siguranță solide în AI. Beneficiile includ o mai bună protecție împotriva abuzurilor — precum solicitări ce ar putea facilita violență pe scară largă sau conținut sexual referitor la minori —, reducerea efortului moderatorilor umani și creșterea încrederii pentru companiile care implementează AI conversațional în customer support sau platforme publice. Poziționarea etică a AI devine astfel un diferențiator important pe piață pentru Anthropic, pe măsură ce organizațiile acordă prioritate conformității și gestionării riscului.

Cazuri de utilizare și recomandări de implementare

Situații concrete unde oprirea sesiunii poate fi utilă:

- Bots de suport clienți care trebuie să dezamorseze și să oprească firele abuzive

- Chatbot-uri publice pe platforme comunitare unde resursele de moderare sunt limitate

- Asistenți enterprise care trebuie să respecte reglementările de conținut și politicile interne de siguranță

Limitări și aspecte etice

Închiderea unei conversații reprezintă o decizie de politică implementată de Anthropic, nu dovada conștiinței unei mașini. Modelele lingvistice mari sunt sisteme antrenate statistic, iar comportamentele lui Claude reflectă instructajul de aliniere și declanșatoarele de siguranță programate. Este esențial ca dezvoltatorii să monitorizeze apariția rezultatelor fals pozitive, să asigure transparență în comunicarea cu utilizatorii și să ofere soluții clare în caz de întreruperi accidentale ale sesiunilor.

Concluzie

Actualizarea venită de la Anthropic introduce un nivel practic și ușor de utilizat de protecție în Claude Opus 4 și 4.1, conferindu-i acestuia capabilitatea de a opri sesiuni în caz de abuz extrem și repetat. Pentru companiile și platformele care adoptă modele lingvistice mari, această funcție reprezintă un instrument valoros pentru moderarea conținutului și reducerea riscului, susținând evoluția industriei către AI etic, aliniere a modelelor și limite solide de siguranță conversațională.

Sursa: lifehacker

Lasă un Comentariu