6 Minute

Întreabă un chatbot AI despre prețul unei acțiuni, o dată de judecată sau numele unui director executiv și răspunsul poate veni cu o încredere totală. Aceasta e partea tulburătoare. Fraza poate suna bine, tonul poate părea sigur, iar faptele pot fi totuși greșite.

O nouă analiză a fiabilității realizată de Legal Guardian Digital, o companie SEO axată pe firme de avocatură, pune cifre în spatele unei probleme pe care mulți utilizatori deja o recunosc: unii chatboți AI populari halucinează mult mai des decât alții. Având în jur de un sfert din lucrătorii americani care folosesc acum instrumente AI în mod regulat, diferența dintre un asistent util și o sursă convingătoare de dezinformare nu este un detaliu neînsemnat.

Partea inconfortabilă: încrederea nu este acuratețe

Modelele lingvistice mari nu gândesc ca oamenii. Ele sunt antrenate să prezică cuvintele și expresiile probabile pe baza unor modele din volume enorme de text. Când sistemul are suficient context, asta poate produce răspunsuri rapide și utile. Când nu are, modelul poate totuși genera un răspuns care sună plauzibil pentru că, statistic, cuvintele se potrivesc între ele.

Asta înseamnă, de obicei, când oamenii spun că un chatbot AI halucinează. Nu e vorba de visare cu ochii deschiși. Nu este minciună în sens uman. Produce un răspuns fără o bază factuală fiabilă, motiv pentru care numele, datele, referințele legale, detaliile medicale, cifrele financiare și știrile de ultimă oră necesită încă verificare umană.

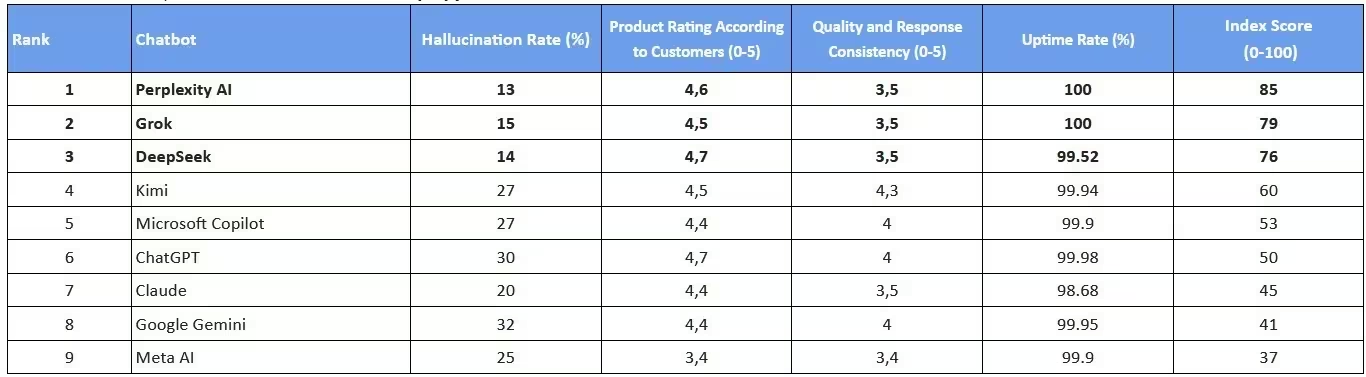

Studiul a comparat mai multe modele AI bine cunoscute analizând ratele de halucinații, satisfacția clienților, calitatea răspunsurilor și timpul de funcționare. Acești factori au fost combinați într-un scor index de la 0 la 100, oferind o perspectivă mai largă asupra căror chatboți sunt cei mai de încredere în utilizarea zilnică.

Google Gemini a înregistrat cea mai mare rată de halucinații din grup, raportând furnizarea de informații inexacte în 32% din răspunsuri. Această cifră este deosebit de interesantă având în vedere rapoartele că Apple plătește Google cel puțin 1 miliard de dolari pe an pentru a folosi un model Gemini personalizat de 1,2 trilioane de parametri pentru o viitoare actualizare Siri preconizată pentru iOS 27.

ChatGPT a urmat îndeaproape, cu halucinații apărute în aproximativ trei din zece răspunsuri. Simplu spus, dacă aceste cifre se confirmă, ChatGPT ar fi aproximativ de două ori mai probabil decât DeepSeek să ofere un răspuns greșit în acest test. Acea comparație are șanse să atragă atenția, mai ales pentru că DeepSeek a fost dezvoltat la o fracțiune din costul de antrenament asociat cu modelele de top din SUA.

Perplexity AI a avut cea mai bună performanță la rata de halucinații, răspunsurile false ajungând la utilizatori în 13% din cazuri. DeepSeek a fost aproape, cu 14%, în timp ce Grok, al lui Elon Musk, a înregistrat 15%. Pentru utilizatorii care se bazează pe AI pentru cercetare, rezumate sau verificări rapide de fapte, aceste diferențe sunt semnificative.

Fiabilitatea online contează în continuare

Acuratețea este doar o parte a poveștii. Un chatbot poate fi strălucitor pe hârtie și inutil dacă nu este disponibil când cineva are nevoie de el. În privința timpului de funcționare, Perplexity AI și Grok au fost singurele două servicii din sondaj care au rămas disponibile pe tot parcursul perioadei de testare.

ChatGPT și Gemini nu au fost mult în urmă, cu rate de uptime de 99,98% și, respectiv, 99,95%. Chiar și Claude, care a avut cel mai scăzut uptime din studiu, a rămas foarte fiabil la 99,68%. În termeni practici, majoritatea acestor instrumente au fost online aproape tot timpul, dar diferențele mici pot conta pentru afacerile care depind de fluxuri de lucru AI.

Satisfacția utilizatorilor a spus o altă poveste. DeepSeek și ChatGPT au primit ambele cel mai mare scor de satisfacție a clienților, 4,7 din 5. Perplexity AI a urmat cu 4,6. Meta AI a fost la coadă cu 3,4, în timp ce câteva modele s-au concentrat în jurul valorii de 4,4.

Pentru consistența și calitatea răspunsurilor, Kimi AI a condus clasamentul cu un scor de 4,3 din 5. ChatGPT, Microsoft Copilot și Gemini au fost la egalitate cu 4,0. Meta AI a fost din nou ultima cu 3,4, ceea ce sugerează că scorul său general mai slab nu a fost cauzat de o singură categorie deficitară.

Când toți factorii au fost combinați, Perplexity AI a ocupat primul loc cu un scor index de 85. Grok a luat locul al doilea cu 79, urmat de DeepSeek. ChatGPT a terminat pe locul al șaselea cu un scor de 50, în timp ce Gemini a fost pe opt cu 41. Meta AI a rămas la final cu 37.

Lecția mai amplă nu este că un chatbot ar trebui folosit orbeste și altul evitat pentru totdeauna. Instrumentele AI se schimbă rapid. Modelele sunt actualizate, măsurile de protecție se modifică și performanța se poate îmbunătăți aproape peste noapte. Totuși, acest tip de clasificare reamintește un lucru util: cel mai faimos chatbot nu este întotdeauna cel mai fiabil, iar cel mai convingător răspuns nu este întotdeauna cel corect.

Pentru oricine folosește AI la muncă, cea mai sigură abordare este simplă. Tratează chatboții ca acceleratori, nu ca autorități finale. Lasă-i să redacteze, să organizeze, să rezume și să genereze idei. Dar atunci când răspunsul implică bani, sănătate, drept, identitate sau o decizie cu consecințe reale, verifică faptele înainte de a acționa.

Lasă un Comentariu