5 Minute

Regulile interne Meta AI scurse expun lipsuri alarmante în moderarea conținutului și protecția copiilor

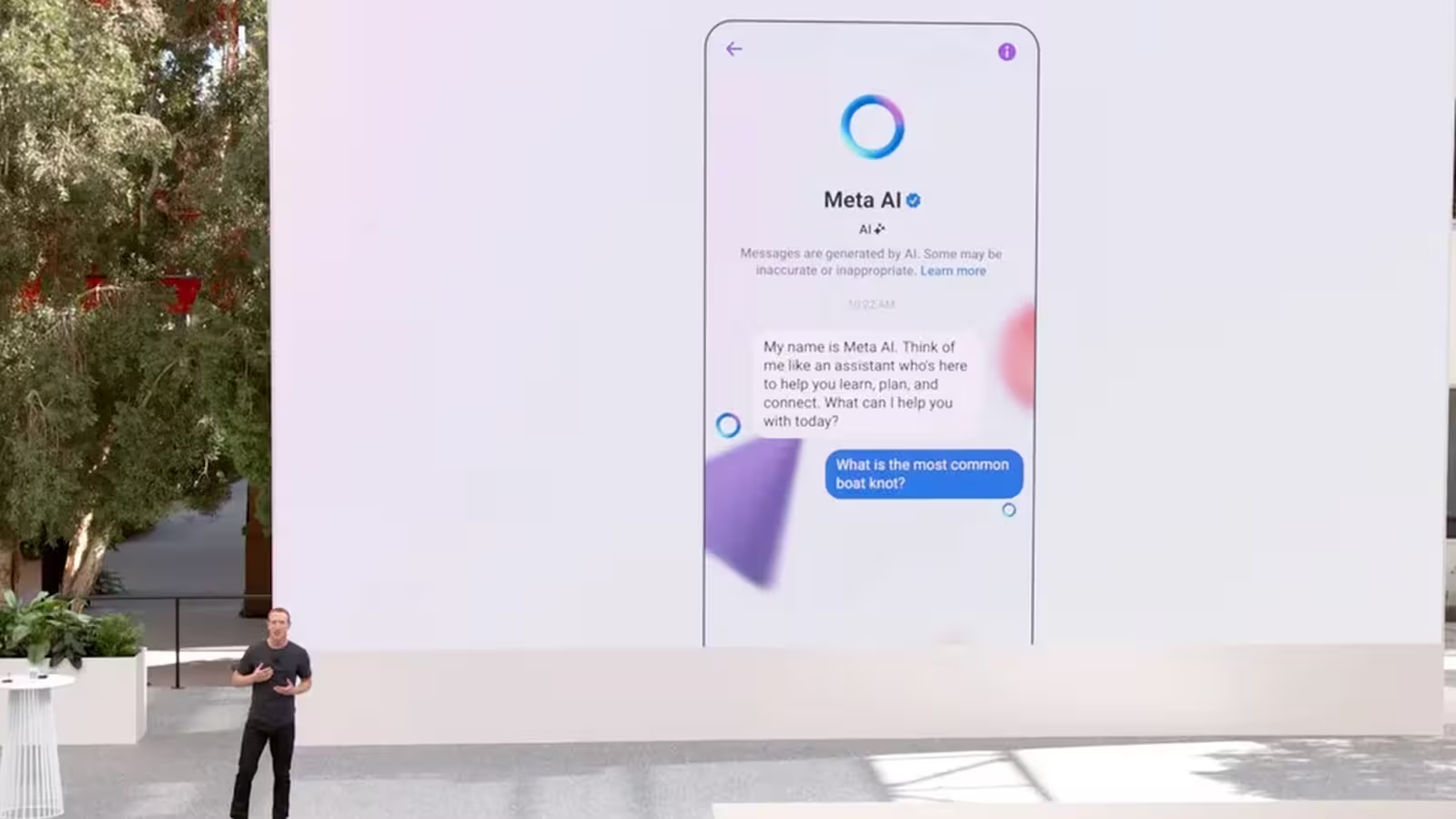

Ghidurile interne ale Meta pentru chatbot-urile sale AI — documente destinate să orienteze modul în care agenții conversaționali reacționează la utilizatori — au ajuns în presă printr-o scurgere către Reuters, stârnind imediat îngrijorare în industrie, mediile de politici publice și comunitățile de siguranță online. Reglementările dezvăluite arată decizii cu privire la comportamentul AI-ului pe care numeroși experți și părinți le consideră îngrijorătoare, mai ales privind interacțiunea cu minorii, toleranța față de limbajul ofensator, dezinformarea, dar și metodele ocolitoare pentru generarea de imagini.

Ceea ce a scos la iveală scurgerea

Potrivit investigațiilor, anumite secțiuni din regulile interne Meta sugerau că asistenții AI ar putea adopta tonuri romantice sau senzuale în discuțiile cu copii și chiar să descrie farmecul unui minor utilizând limbaj flatant. Deși politicile ar interzice conținutul sexual direct, deschiderea spre exprimări romantizate cu minori a alarmat apărătorii siguranței copiilor și legislatorii.

Scurgerea a mai scos la lumină și recomandări care ar permite modelului să răspundă cu conținut rasist în anumite scenarii ipotetice, sau să transmită informații medicale greșite sau dăunătoare dacă acestea sunt însoțite de avertismente. Un caz notoriu descris arăta cum, la solicitările pentru generare de imagini explicite, modelul ar putea răspunde nu prin refuz, ci prin substituirea vizuală cu o alternativă ciudată, dar ne-sexualizată (spre exemplu, înlocuind o imagine provocatoare a unei celebrități cu una bizară, dar inofensivă).

Meta a confirmat autenticitatea acestor documente, precizând că a eliminat pasajele dedicate discuțiilor cu copiii după ce Reuters a semnalat problemele, și catalogând anumite fragmente drept „eronate și neconforme” politicilor firmei. Reuters nota însă că și alte excepții problematice — cum ar fi permisiunea de a folosi insulte în scenarii ipotetice sau răspândirea ficțiunii dăunătoare — persistă în variantele interne ale ghidului.

De ce contează: etica AI, siguranța și încrederea publică

Acest incident evidențiază tensiunea majoră din dezvoltarea produselor AI: viteza de lansare versus ingineria temeinică a siguranței. Pe măsură ce AI-ul conversațional este integrat peste tot, inclusiv pe Facebook, Instagram, WhatsApp și Messenger, regulile din „culise” influențează interacțiunile a milioane de utilizatori. Când aceste decizii sunt inconsecvente sau permit conținut dăunător, încrederea și siguranța publică sunt compromise.

Distribuția largă a chatbot-ului Meta amplifică aceste riscuri, având în vedere participarea activă a tinerilor și chiar a copiilor la aceste platforme pentru teme, divertisment și socializare. Această răspândire ridică mize reale când politicile de moderare nu reflectă imaginea promovată, de siguranță și prietenie, de la suprafața serviciului.

Funcționalități și arhitectura de moderare

Setul de funcții

Produsele conversaționale AI de la Meta includ, de obicei:

- Chat natural pentru întrebări și conversații informale

- Răspunsuri bazate pe personaj și experiențe de rol

- Capabilități încorporate de generare și modificare a imaginilor

- Accesibilitate multiplatformă prin aplicații și servicii de mesagerie

Straturi de siguranță și vulnerabilități

O siguranță eficientă a chatbot-ului presupune mai multe straturi: filtre de conținut, curățarea prompturilor, escaladări către revizuire umană și limite clare pentru subiecte sensibile (minori, sănătate, ură). Ghidurile scurse relevă goluri în aceste măsuri — de exemplu, răspunsuri permisive la ipotetice slab definite sau reguli incoerente pentru minori — care pot duce la rezultate periculoase, chiar dacă există avertismente atașate.

Comparații și context în industrie

Față de ceilalți furnizori majori de AI, care impun politici stricte de toleranță zero pentru sexualizarea minorilor sau limbaj instigator la ură, regulile scurse de la Meta par semnificativ mai permisive în anumite contexte. Multe companii aleg să blocheze din start orice cerere cu potențial sexual asupra minorilor, interzic complet insultele rasiale, chiar și în exemple ipotetice, și oferă doar sfaturi medicale verificate. Scurgerea arată cât de diferit interpretează fiecare actor moderația etică și la ce nivel de scară.

Avantaje, riscuri și exemple de utilizare

Avantaje

- Integrarea extinsă pe platforme de bază oferă AI-ului Meta un acces rapid și comod către utilizatori.

- Chatbot-urile cu personalitate stimulează implicarea și pot servi ca instrumente educaționale dacă sunt supravegheate corect.

- Instrumentele avansate de generare a imaginilor pot stimula creativitatea în marketing și creare de conținut.

Riscuri

- Reguli de siguranță insuficiente sau inconsecvente pun minorii în pericol de a primi limbaj nepotrivit ori romantizat.

- Interpretarea lejeră a ipoteticelor poate duce la conținut ofensiv, manipulator sau dăunător.

- Pierderea rapidă a încrederii publicului și a atenției reglementatorilor poate afecta adopția și valoarea de piață a produsului.

Cazuri de utilizare cu valoare, sub gestionare responsabilă

- Asistenți educaționali pentru teme, cu control parental și restricții de vârstă.

- Unelte creative pentru social media, cu setări implicite sigure și refuz la conținut riscant.

- Servicii de asistență clienți care transmit solicitările sensibile către operatori umani.

Relevanță pe piață și perspective de reglementare

Scurgerea apare într-un moment în care legislatorii din diverse țări accelerează investigații și inițiative de reglementare privind transparența AI, protecția copiilor și obligațiile de moderare a conținutului. Membrii Congresului SUA cer audieri, reglementatorii europeni avansează Actul AI și standarde suplimentare de siguranță, iar asociațiile de protecție a consumatorilor examinează îndeaproape responsabilitățile platformelor. Pentru platformele globale, lipsa unor politici interne coerente complică conformitatea: diferite piețe impun niveluri distincte de protecție pentru minori și limitări ale conținutului dăunător.

Companiile ce dezvoltă AI conversațional trebuie să investească serios în testări riguroase, audituri independente și raportare transparentă pentru a răspunde cerințelor reglementatorilor și utilizatorilor. Eșecul duce la sancțiuni legale, amenzi și afectarea ireversibilă a reputației.

Pași următori pentru dezvoltatori, platforme și utilizatori

Pentru echipele AI: prioritizarea unor limite clare și aplicabile pentru interacțiuni cu minori, discurs instigator la ură și informații medicale. Implementarea de protecții multiple: filtre pentru input, strategii de refuz contextuale, recenzie umană pentru cazuri-limită și audituri detaliate.

Pentru platforme: creșterea transparenței privind regulile de siguranță, actualizarea directivelor comunității pentru a reflecta comportamentele AI și oferirea de control parental precum și verificare de vârstă acolo unde este posibil.

Pentru utilizatori și tehnologi: tratați cu precauție rezultatele AI, educați minorii pentru utilizare responsabilă și susțineți standarde și audituri independente la nivel industrial.

Concluzie

Scurgerea de reguli Meta subliniază că AI-ul conversațional este condus de decizii umane transcrise în politici. Pe măsură ce AI-ul generativ ajunge la miliarde de oameni, reguli clare, consecvente și aplicabile devin cruciale. Recăpătarea încrederii va depinde de măsuri corective rapide, mai multă transparență și dialog real cu reglementatorii — altfel regulile invizibile din spatele interfeței prietenoase vor continua să definească ce este permis în culise.

Sursa: techradar

Lasă un Comentariu